Die strategische Intelligence-Lücke

Stellen Sie sich folgendes Szenario vor: Ein großer Automobilhersteller stellte fest, dass ein Wettbewerber seit achtzehn Monaten aktiv Open-Source-Software für das Batteriemanagement entwickelt hatte — Informationen, die auf GitHub öffentlich zugänglich waren, für das Marktintelligence-Team jedoch unsichtbar blieben. Als die Produktteams Wettbewerbsanalyseberichte erhielten, hatte der Rivale bereits Partnerschaften mit drei großen Zulieferern gesichert. Das Problem war kein Versagen der Intelligence-Beschaffung. Es war ein Versagen der Sucharchitektur.

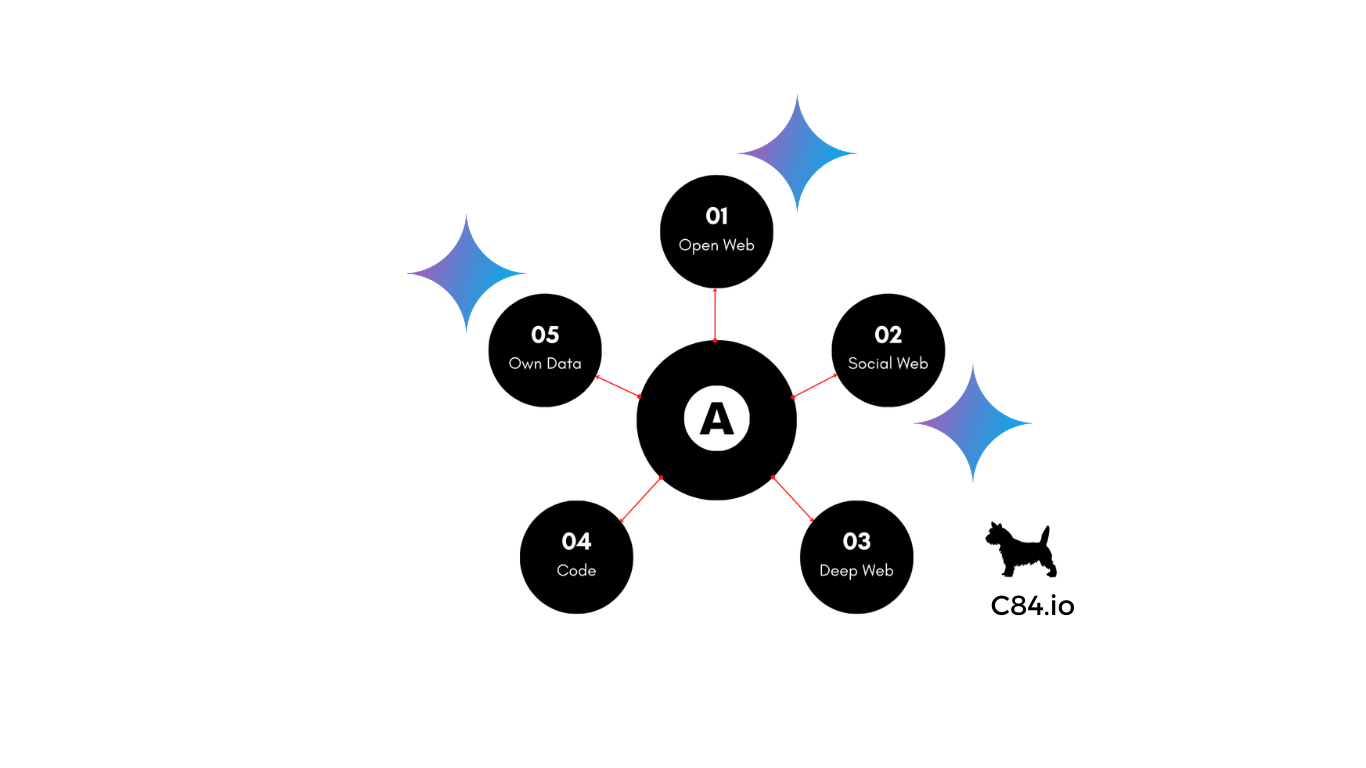

Organisationen operieren heute unter einer gefährlichen Annahme: dass Zugang zu Informationen gleich Intelligence ist. In Wirklichkeit hat sich die moderne Datenlandschaft in fünf verschiedene Suchökosysteme fragmentiert, jedes mit spezialisierter Infrastruktur, Zugriffsprotokollen und Domänen-Know-how. Unternehmen, die keine Architektur für diese Fragmentierung aufgebaut haben, sind systematisch blind gegenüber Bedrohungen, Chancen und Marktbewegungen, die im Verborgenen stattfinden — nur in anderen Datenbanken.

Dies ist kein Technologieproblem. Es ist ein strategisches Architekturproblem mit Wettbewerbsfolgen.

Warum traditionelle Intelligence-Frameworks versagen

Das dominante Modell für Wettbewerbs- und Markt-Intelligence wurde für eine einfachere Informationsumgebung entwickelt. Teams überwachen Newsfeeds, beauftragen Marktforschungsberichte, besuchen Branchenkonferenzen und verfolgen Ankündigungen von Wettbewerbern. Dieser Ansatz setzt voraus, dass strategisch relevante Informationen durch etablierte, zentralisierte Kanäle fließen.

Diese Annahme ist überholt.

Betrachten Sie, wie strategisch bedeutsame Informationen nun über grundlegend verschiedene Suchinfrastrukturen verteilt sind:

Open-Web-Suchmaschinen bieten universellen Zugang zu indexierten Inhalten, ihr Umfang ist jedoch auf das beschränkt, was Crawler erreichen können. Kostenpflichtige Recherchen, dynamisch generierte Inhalte und gezielt verschleierte Informationen bleiben unsichtbar.

Soziale Plattformen fungieren als nicht erkannte Suchmaschinen mit proprietären Indizes für Nutzerverhalten, Stimmungen und aufkommende Trends. Instagram Explore, LinkedIn-Talentsuche und X-Erweiterte-Operatoren pflegen ausgefeilte Datenbanken, die Kundenpräferenzen, Talentbewegungen und Marktstimmung in Echtzeit offenbaren.

Deep-Web-Datenbanken enthalten die reichhaltigste domänenspezifische Intelligence: akademische Forschung, Gerichtseinreichungen, branchenspezifische Plattformen, Regulierungsdatenbanken und Spezialforen.

Code-Repositorys legen technologische Entwicklungen offen, bevor sie sich in Produkten manifestieren. GitHub, GitLab und spezialisierte Plattformen indexieren Programmierungsmuster, Abhängigkeitsgraphen und Entwicklungsgeschwindigkeit.

First-Party-Datensysteme — CRM-Plattformen, ERP-Systeme, Support-Datenbanken — enthalten die vertraulichsten Informationen über Kundenverhalten und operative Performance. Ohne externen Kontext isoliert offenbart interne Daten jedoch Trends, ohne Ursachen zu erklären.

Die kumulativen Kosten der Fragmentierung

Diese architektonische Fragmentierung erzeugt drei Kategorien strategischen Versagens:

Latenzlücken: Informationen existieren und sind zugänglich, aber organisatorische Prozesse können sie nicht schnell genug abrufen. Bis fragmentierte Intelligence Entscheidungsträger erreicht, haben Wettbewerber bereits auf dieselben Signale reagiert.

Sichtbarkeitslücken: Informationen existieren, befinden sich jedoch in Ökosystemen, in denen die Organisation keine Suchkapazität hat. Regulatorische Änderungen in Spezialforen, technische Entwicklungen auf GitHub, Stimmungsverschiebungen auf sozialen Plattformen — alles unsichtbar für Teams, die nur traditionelle Quellen abfragen.

Syntheselücken: Informationsfragmente existieren über mehrere Systeme verteilt, aber keine Infrastruktur verbindet sie zu kohärenter Intelligence. Ein Anstieg von Support-Tickets ergibt erst Sinn, wenn er mit sozialer Stimmung, Repository-Aktivität und regulatorischen Diskussionen korreliert wird.

Die Multi-Source-Intelligence-Architektur

Führende Organisationen reagieren nicht, indem sie mehr Analysten einstellen, sondern indem sie eine einheitliche Suchinfrastruktur über fragmentierte Ökosysteme hinweg architektieren. Dies erfordert drei grundlegende Fähigkeiten:

Föderierte Suchorchestierung: KI-Systeme, die verstehen, welche Datenbanken relevante Informationen enthalten und wie diese effektiv abzufragen sind. Dies ist keine Suchaggregation — es ist intelligentes Routing, das weiß, ob eine Frage Open-Web-Indizes, Social-Platform-APIs, Deep-Web-Datenbanken, Code-Repositorys oder interne Systeme erfordert.

Systemübergreifende Authentifizierung und Zugang: Technische Infrastruktur, die Zugangsdaten über Plattformen hinweg pflegt und dabei Zugriffskontrollen, Ratenbeschränkungen und Compliance-Anforderungen respektiert.

Mustersynthese über heterogene Daten: Analytische Frameworks, die Zusammenhänge zwischen regulatorischen Änderungen, technischen Entwicklungen, Marktstimmung, Wettbewerberpositionierung und internen Leistungsmetriken identifizieren.

Von Zugang zu Wettbewerbsvorteil

Der Wettbewerbsgraben ist nicht der Zugang zu einer einzigen Datenquelle — es ist die Infrastruktur zur systematischen Synthese über alle hinweg. Ein Unternehmen, das nur Open-Web-Quellen überwacht, erfährt von regulatorischen Änderungen, wenn diese angekündigt werden. Ein Unternehmen mit Deep-Web-Suchkapazität sieht diese Änderungen Monate früher in regulatorischen Arbeitsgruppen diskutiert.

Die strategische Frage ist nicht, ob Organisationen auf diese fünf Ebenen zugreifen können. Die meisten können, mit ausreichend Zeit und Ressourcen. Die Frage ist, ob sie sie gleichzeitig, kontinuierlich abfragen und Ergebnisse schneller als Wettbewerber synthetisieren können.

Implementierungsrealitäten

Der Aufbau einer Multi-Source-Intelligence-Architektur erfordert die Bewältigung praktischer Herausforderungen, die das Vendor-Marketing verharmlost. Authentifizierungskomplexität ist die erste Hürde — die Pflege aktiver Zugangsdaten über Dutzende von Plattformen unter Berücksichtigung von Ratenbeschränkungen, Nutzungsbedingungen und geografischen Zugriffsbeschränkungen erfordert kontinuierliche operative Aufmerksamkeit.

Datennormalisierung ist die zweite Herausforderung. Jedes Suchökosystem liefert Ergebnisse in proprietären Formaten mit unterschiedlichen Metadatenschemata, Konfidenz-Signalen und temporalen Markierungen. Die Synthese von Signalen über diese Formate hinweg erfordert erhebliche Data-Engineering-Investitionen.

Die dritte Herausforderung ist die Relevanzkalibrierung. Multi-Source-Architekturen erzeugen massive Signalvolumina; ohne ausgefeiltes Filtern ertrinken Teams in Rauschen, während sie die strategischen Signale verpassen, die sie aufdecken sollten.

Organisationen, die erfolgreich sind, beginnen typischerweise mit einem spezifischen, hochwertigem Anwendungsfall — Wettbewerber-Technologie-Monitoring, regulatorische Änderungserkennung oder Talentbewegungs-Tracking — bauen Kapazität in dieser Domäne auf und expandieren systematisch.

Die Frage voraus

Die Fragmentierung der Sucharchitektur ist kein vorübergehender Zustand, der auf eine dominierende Plattform wartet. Sie spiegelt die zugrunde liegende Struktur wider, wie verschiedene Arten von Informationen produziert, verwaltet und zugänglich gemacht werden — und diese Struktur wird differenzierter, nicht weniger.

Organisationen, die jetzt in Multi-Source-Suchinfrastruktur investieren, bauen eine Fähigkeit auf, die wertvoller wird, je mehr die Fragmentierung zunimmt. Diejenigen, die die Investition verschieben, bewahren keine Optionalität — sie fallen weiter hinter Wettbewerber zurück, die die architektonische Arbeit bereits begonnen haben.

Die Wettbewerbs-Intelligence-Frage des nächsten Jahrzehnts lautet nicht: „Auf welche Informationen können wir zugreifen?" Sie lautet: „Wie schnell können wir über die Ökosysteme synthetisieren, in denen die wichtigsten Informationen leben?"